Reguliarizavimas (matematika)

Reguliarizavimas matematikoje – papildomos (apriorinės) informacijos panaudojimas sprendžiant nekorektiškus uždavinius. Metodiniu požiūriu tai yra Okamo skustuvo principo taikymas atrenkant tinkamus sprendinius iš daugybės kitų.[1] Žinomiausi reguliarizavimo taikymo pavyzdžiai yra Tichonovo reguliarizavimas ieškant integralinių lygčių sprendinių bei Bajeso metodų taikymas statistikos uždaviniuose.

Tarkime turime integralinę lygtį operatorinėje formoje:

Čia yra operatorius, atvaizduojantis ieškomą vektorių/funkciją į eksperimentuose gaunamą vektorių/funkciją . Net mažos matavimo paklaidos gali smarkiai paveikti ieškomą . Tuomet vietoj „tikro“, glotnaus, gaunamas smarkiai osciliuojantis sprendinys. Norint to išvengti, šalia mažiausių kvadratų metodu minimizuojamo nario dar pridedamas papildomas narys , stabilizuojantis mūsų sprendinį:

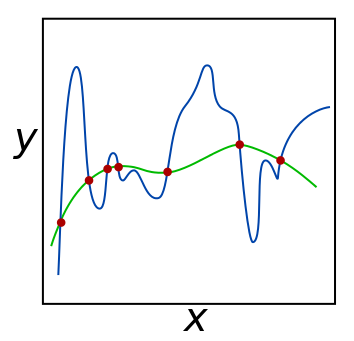

Paprastai papildomas narys būna tiesiog vienetinė matrica: . Tačiau tai gali būti ir operatorius, susijęs su išvestine. Tinkamai parinkus svorius osciliuojantys sprendiniai atmetami (paveikslėlyje mėlynoji linija) ir paliekami tik glotnūs (žalioji linija).

Šaltiniai

[redaguoti | redaguoti vikitekstą]- ↑ Seth, Neha. „What Is Regularization in Machine Learning? Techniques & Methods“. Blogs & Updates on Data Science, Business Analytics, AI Machine Learning. Nuoroda tikrinta 2024-02-03.